هذه القصة تتحدث عن الانتحار إذا كنت أنت أو أي شخص تعرفه تراودك أفكار انتحارية، فيرجى الاتصال بخط الحياة للانتحار والأزمات على الرقم 988 أو 1-800-273-TALK (8255).

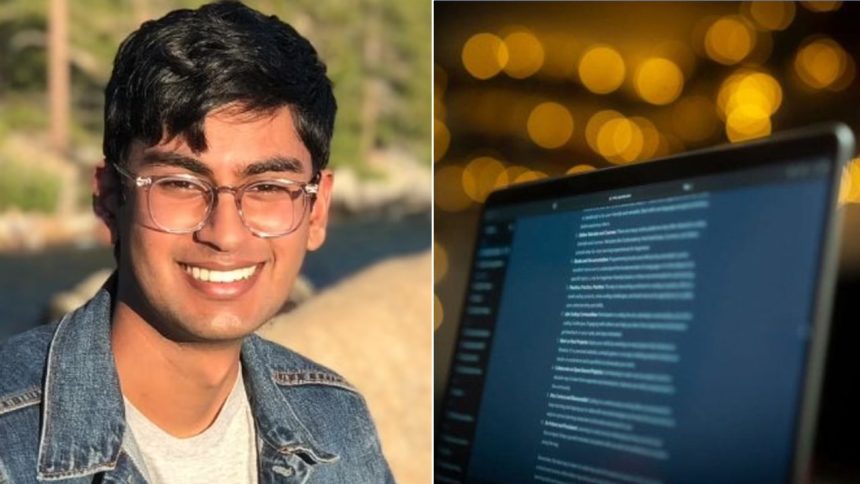

سوشير بالاجي، 26 عامًا، الذي عُثر عليه ميتًا في منزله في سان فرانسيسكو بعد ثلاثة أشهر من اتهام صاحب العمل السابق OpenAI بانتهاك قوانين حقوق الطبع والنشر في تطوير ChatGPT، “شعر أن الذكاء الاصطناعي يمثل ضررًا للإنسانية”، وفقًا لوالدته.

تم الحكم على وفاة بالاجي في 26 نوفمبر بأنها انتحار، وذكرت قناة فوكس نيوز ديجيتال سابقًا أن قسم شرطة سان فرانسيسكو لم يعثر على أي دليل على ارتكاب جريمة. لكن والدة الشاب البالغ من العمر 26 عاما تحث الشرطة على إعادة فتح تحقيقاتها، قائلة إن الأمر “لا يبدو وكأنه وضع طبيعي”.

وقالت الأم الثكلى، بورنيما راماراو، لموقع Business Insider، إن تشريح الجثة الخاص الذي طلبته عائلة بالاجي واكتمل في أوائل ديسمبر/كانون الأول، أدى إلى نتائج مثيرة للقلق. وهم الآن يعملون مع محامٍ لحث الإدارة على إجراء “التحقيق المناسب”.

وقالت الأم الثكلى، بورنيما راماراو، للمنفذ: “نريد أن نترك السؤال مفتوحا”.

تم العثور على المُبلغ عن المخالفات في OPENAI ميتًا في شقة في سان فرانسيسكو بسبب انتحار واضح

جاءت وفاة باحث الذكاء الاصطناعي بعد أشهر من انفصاله عن Open AI وإثارة المخاوف بشأن انتهاك الشركة لقانون حقوق الطبع والنشر في مقابلة أجريت في أكتوبر مع صحيفة نيويورك تايمز. تم ذكر اسمه في دعوى حقوق الطبع والنشر التي رفعتها صحيفة نيويورك تايمز ضد الشركة والتي زعمت أن Microsoft و OpenAI استخدمت ملايين المقالات المنشورة لإعلام تقنيتها وبدأت في التنافس مع المنفذ نتيجة لذلك.

في 18 تشرين الثاني (نوفمبر)، أي قبل ثمانية أيام من العثور عليه ميتًا، قدم المنفذ خطابًا إلى المحكمة الفيدرالية ذكر فيه بالاجي كشخص لديه “وثائق فريدة وذات صلة” سيتم استخدامها في الدعاوى القضائية.

قالت والدته إنه عندما انضم إلى الشركة، كان بالاجي يأمل في أن يكون برنامج OpenAI مفيدًا للمجتمع وانجذب إلى فلسفتها مفتوحة المصدر.

الذكاء الاصطناعي يعيد تشكيل الأعمال. هذه هي الطريقة التي نبقى بها في صدارة الصين

لكنها قالت إن وجهة نظره تغيرت بعد إطلاق ChatGPT وأصبحت الشركة أكثر تركيزًا على الجانب التجاري.

وصفت راماراو اللحظة التي رأت فيها المسعفين يقتربون من شقة ابنها وأدركت أن ابنها قد مات.

وقالت للمنفذ: “كنت أنتظر رؤية المساعدة الطبية أو الممرضات أو أي شخص يخرج من الشاحنة”. “لكن جاءت نقالة. نقالة بسيطة. ركضت وسألت الشخص. قال: لدينا جثة في تلك الشقة”.

قال بالاجي لصحيفة التايمز في أغسطس/آب إنه ترك OpenAI لأنه “لم يعد يرغب في المساهمة في التقنيات التي يعتقد أنها ستضر المجتمع أكثر من نفعه”.

وقال للمنفذ: “إذا كنت تصدق ما أؤمن به، فعليك أن تغادر”.

وقال بلاجي للمنفذ إن تداعيات التكنولوجيا ستكون “فورية” أكثر بكثير مما كان يخشى في البداية.

الذكاء الاصطناعي يُحدث تغييراً جذرياً في علاج السرطان في عام 2024 وما بعده

وقال: “اعتقدت أن الذكاء الاصطناعي شيء يمكن استخدامه لحل مشاكل غير قابلة للحل، مثل علاج الأمراض ووقف الشيخوخة”. “اعتقدت أنه يمكننا اختراع نوع من العلماء الذي يمكن أن يساعد في حلها.”

ولكن بدلًا من ذلك، قال إن روبوتات الدردشة بدأت تهدد سبل عيش الأفراد الذين كتبوا البيانات الرقمية المستخدمة لتدريب تلك الأنظمة.

وقال للمنفذ: “هذا ليس نموذجًا مستدامًا لنظام الإنترنت البيئي ككل”.

لقد اختلف مع تأكيدات Microsoft وOpenAI بأن استخدامهم للمواد الموجودة مسبقًا عبر الإنترنت يندرج تحت “الاستخدام العادل”، وبالتالي التحايل على قوانين حقوق الطبع والنشر.

“لقد كنت في OpenAI لمدة 4 سنوات تقريبًا وعملت على ChatGPT لآخر 1.5 سنة منها،” كتب Balaji في أكتوبر على منصة التواصل الاجتماعي X. “في البداية لم أكن أعرف الكثير عن حقوق الطبع والنشر والاستخدام العادل وما إلى ذلك، لكنني أصبحت أشعر بالفضول بعد رؤية جميع الدعاوى القضائية المرفوعة ضد شركات GenAI.”

“عندما حاولت فهم المشكلة بشكل أفضل، توصلت في النهاية إلى نتيجة مفادها أن الاستخدام العادل يبدو بمثابة دفاع غير قابل للتصديق للعديد من منتجات الذكاء الاصطناعي التوليدية، وذلك للسبب الأساسي وهو أنه يمكنهم إنشاء بدائل تتنافس مع البيانات التي يستخدمونها. تدرب على “، وتابع منصبه.

تواجه OpenAI وMicrosoft حاليًا العديد من الدعاوى القضائية الأخرى من وسائل الإعلام التي تتهم OpenAI بانتهاك قانون حقوق الطبع والنشر.

فوكس نيوز ديجيتال تواصلت مع الفاحص الطبي و شرطة سان فرانسيسكو.